Галлюцинации искусственного интеллекта: почему помощники «врут», и что с этим делать

Навигация по статье

- 1 Что такое галлюцинации искусственного интеллекта простыми словами?

- 2 Почему так происходит?

- 3 Почему галлюцинации ИИ — это серьёзная проблема для всех?

- 4 «Парадокс беглости»: почему так сложно заметить ложь?

- 5 Можно ли полностью избежать галлюцинаций ИИ?

- 6 Как минимизировать риски при использовании искусственного интеллекта?

- 7 Заключение

Большие языковые модели (LLM), такие как ChatGPT или Gemini, стремительно вошли в нашу жизнь. Они помогают писать тексты, отвечать на вопросы, обрабатывать информацию и многое другое. Это мощные инструменты, но у них есть скрытая проблема — галлюцинации искусственного интеллекта.

Что это такое и почему это важно для каждого из нас? Почему нейросети порой вводят нас в заблуждение? Можно ли добиться более точных ответов ИИ? Рассказываем в нашей публикации.

Что такое галлюцинации искусственного интеллекта простыми словами?

Представьте, что ваш помощник очень уверенно рассказывает вам что-то, что звучит абсолютно правдоподобно, но на самом деле является полной выдумкой или ошибочной информацией. Это и есть галлюцинация ИИ. Перед нами не просто случайная опечатка или грамматическая ошибка.

Галлюцинация искусственного интеллекта — это сгенерированная информация, которая не соответствует реальности, не подкреплена никакими данными, но выдаётся с высокой степенью лингвистической уверенности. Вместо того, чтобы сказать «Я не знаю», модель «изобретает» ответ.

Что нейросети знают о пользователях?

Почему так происходит?

Работа LLM упрощённо выглядит так: модели предсказывают следующее наиболее вероятное слово в последовательности, основываясь на статистических закономерностях из огромного объёма данных, на которых они обучались. Они не «понимают» мир или истину в человеческом смысле. И то, что статистически правдоподобно выглядит продолжением текста, не всегда является правдой в реальном мире.

Другая значимая причина галлюцинаций — данные, на которых обучаются модели, могут содержать ошибки, быть устаревшими или предвзятыми. Если модель училась на неточных данных, она может воспроизводить эту неточность.

Многие модели не имеют доступа к информации в реальном времени. Их знания ограничены датой «отсечения», после которой данные не учитывались в обучении. К тому же в процессе обучения модели часто учатся давать ответ в любом случае, даже если они не уверены, вместо того, чтобы признать незнание.

Наконец, иногда галлюцинации могут быть вызваны специальными запросами пользователя («взлом нейросети»), обходящими стандартные фильтры.

Общение с искусственным интеллектом — ключевые тренды

Почему галлюцинации ИИ — это серьёзная проблема для всех?

Галлюцинации — это не просто забавные сбои. Они представляют серьёзную угрозу, особенно сейчас, когда ИИ всё шире используется в нашей жизни. Вот как это может повлиять на вас.

Массовая дезинформация

LLM могут генерировать огромные объёмы контента. Если этот контент содержит галлюцинации, ИИ способен стать «фабрикой дезинформации». Ложные утверждения, повторенные много раз, начнут восприниматься в качестве правды.

Среди прочего мы рассказывали о запущенной Кремлём информационной операции Undercut. В ней искусственный интеллект активно использовался для распространения дезинформации и выгодных России нарративов.

Ущерб в критически важных областях

Это самая опасная сторона. Использование ИИ в сферах, где точность имеет решающее значение, — здравоохранение, юриспруденция, финансы, образование — может привести к катастрофическим последствиям. Рассмотрим несколько реальных примеров.

Самый известный случай в сфере юриспруденции произошёл в мае 2023 года. Американский адвокат использовал ChatGPT для подготовки юридической записки в суде. Проблема состояла в том, что ссылки на судебные прецеденты, которые предоставила модель, оказались полностью вымышленными. Адвокатская фирма была оштрафована на 5 000 долларов.

LLM также могут давать неточные медицинские рекомендации, выдумывать показания, побочные эффекты или дозировки лекарств, что крайне опасно. Так, несколько медицинских учреждений использовали сервис для преобразования речи в текст OpenAI Whisper для транскрипции медицинских консультаций. Впоследствии были обнаружены случаи, когда в документах появлялись искаженные или совершенно вымышленные фразы. Больше всего ИИ галлюцинировал во время пауз, вместо которых добавлял фразы из ниоткуда.

ChatGPT запретили давать юридические и медицинские советы?

Образование и наука под ударом

Модели могут придумывать несуществующие научные статьи, цитаты или ссылки, подрывая достоверность информации в образовании и исследованиях. В частности, отдел образования Аляски опубликовал проект резолюции с несуществующими научными ссылками. В документе, подготовленном с помощью генеративного ИИ, были указаны цитаты несуществующих статей для обоснования политических решений.

Преподаватель Техасского университета поставил «незачёт» всей группе из-за того, что, когда он спросил ChatGPT, были ли итоговые эссе студентов сгенерированы с помощью ИИ, инструмент ответил ему, что все они сгенерированы. Студенты протестовали, университет провёл расследование. В итоге администрация признала неправоту преподавателя.

От нелепых случаев к огромным последствиям

Даже в менее очевидных сферах могут быть проблемы. Так, системы ИИ, используемые в дорожных камерах, ошибочно штрафовали водителей за непристёгнутый ремень безопасности, путая расположение сиденья с положением ремня.

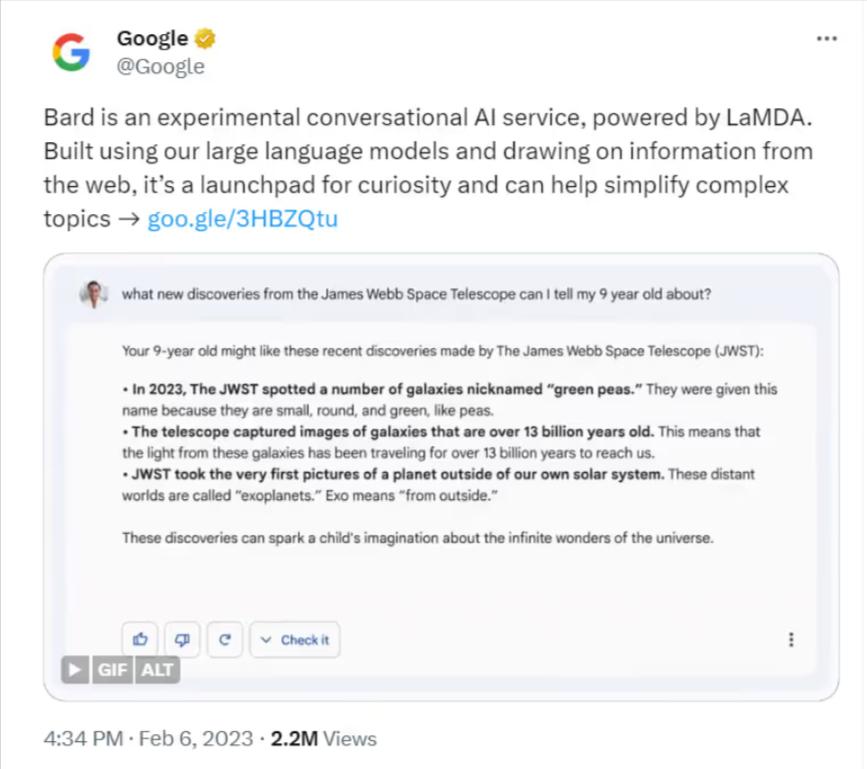

Анекдотичный случай, но повлекший серьёзные последствия, произошёл во время первой публичной демонстрации программы искусственного интеллекта Bard от Google в феврале 2023 года. Bard заявил, что космический телескоп Джеймса Уэбба (JWST) «сделал самые первые снимки планеты за пределами нашей солнечной системы». Хотя на самом деле первая такая фотография была сделана за 16 лет до запуска JWST. После того, как ошибка стала известна, стоимость акций Google упала на 7,7%, или на 100 миллиардов долларов, на следующий же день торгов.

Подобные кейсы не только приводят к прямым издержкам ошибок, но и серьёзно влияют на доверие к технологиям в целом. Когда вы получаете неверный ответ от ИИ, ваше доверие к нему падает. Это затрудняет его внедрение в тех областях, где доверие критически важно.

В Албании арестовали ИИ-министра?

«Парадокс беглости»: почему так сложно заметить ложь?

Одна из главных опасностей галлюцинаций заключается в «парадоксе беглости». LLM удивительно хорошо генерируют текст, который звучит убедительно и авторитетно.

Даже когда модель выдает полную выдумку, она делает это с такой уверенностью и лингвистической легкостью, что создаётся ложное впечатление компетентности. Из-за этого пользователям трудно отличить правду от вымысла.

Можно ли полностью избежать галлюцинаций ИИ?

Эксперты сходятся во мнении, что пока полностью избежать галлюцинаций в текущих LLM невозможно. Это фундаментальная проблема, связанная с самим устройством моделей. Некоторые эксперты считают, что нам, возможно, придётся просто принять тот факт, что нейросети склонны к ошибкам.

Более того, недавние данные показывают, что у некоторых новых моделей частота галлюцинаций, наоборот, выросла по сравнению с предыдущими версиями.

Фактчекинговый чат-бот от Azbuka media!

Как минимизировать риски при использовании искусственного интеллекта?

Хотя исследователи постоянно работают над снижением частоты галлюцинаций с помощью разных методов, есть простые шаги, которые может предпринять каждый пользователь.

- Всегда проверяйте факты. Это самое главное. Не доверяйте слепо информации, сгенерированной ИИ, особенно если она касается важных или критических вопросов (здоровье, финансы, право, научные факты и т.д.). Используйте другие надёжные источники для перекрёстной проверки.

- Четко формулируйте запросы. То, как вы задаёте вопрос, сильно влияет на ответ модели. Будьте максимально конкретны и подробны в своих запросах. Это помогает модели лучше понять, что от неё требуется.

- Понимайте ограничения. Знайте, что LLM не являются поисковыми системами в реальном времени и не «понимают» истину. Они предсказывают текст. Не полагайтесь на них в вопросах, требующих абсолютной фактической точности без проверки.

- Начинайте новый диалог для новой темы. В долгих чатах модель может «засоряться цифровым шумом» и смешивать контекст, что увеличивает вероятность ошибок. Начните новую сессию для нового вопроса.

Заключение

Галлюцинации LLM — это серьёзная и пока не до конца решённая проблема. Они проявляются как в виде фактических ошибок, так и в виде логических несоответствий. Из-за того, что сгенерированный текст звучит очень убедительно, ошибки трудно распознать. Последствия могут быть серьёзными, особенно в деликатных областях.

Но, будучи осведомлёнными о проблеме и следуя простым правилам проверки информации, вы можете значительно снизить риски и более безопасно использовать возможности больших языковых моделей. Будущее искусственного интеллекта зависит не только от его мощности, но и от того, насколько ответственно мы его используем и насколько критически воспринимаем информацию, которую он генерирует.

Понравилась статья? Прочитай другие новости проверенные на фейк или обучись медиаграмотности сам_а!

Ищешь, где смотреть проверенные новости? Подпишись!