ChatGPT запретили давать юридические и медицинские советы?

Навигация по статье

- 1 Откуда взялась новость о запрете ChatGPT давать медицинские и юридические консультации?

- 2 Был ли запрет давать подобные советы в действительности?

- 3 Что на самом деле написано в новом пользовательском соглашении OpenAI?

- 4 Почему новость о запрете нейросети давать юридические и медицинские консультации так быстро разошлась?

- 5 Краткий вывод о правдивости

В ноябре по Интернету разлетелись громкие заголовки о новшествах в работе нейросетей. Пользователям сообщали, что разработчики ChatGPT ввели революционный запрет. Якобы отныне ChatGPT запретили давать юридические и медицинские консультации.

Но действительно ли самый популярный чат-бот мира перестал говорить с людьми о таких темах? И откуда вообще взялась такая информация? Разбираемся далее.

Откуда взялась новость о запрете ChatGPT давать медицинские и юридические консультации?

Поводом для всплеска подобных сообщений стало обновление пользовательского соглашения OpenAI, опубликованное в конце октября. В новых правилах содержалось напоминание: сервисы компании не предназначены для выдачи специализированных советов, которые требуют участия лицензированных специалистов. Среди таких сфер в документе значатся медицина и юриспруденция.

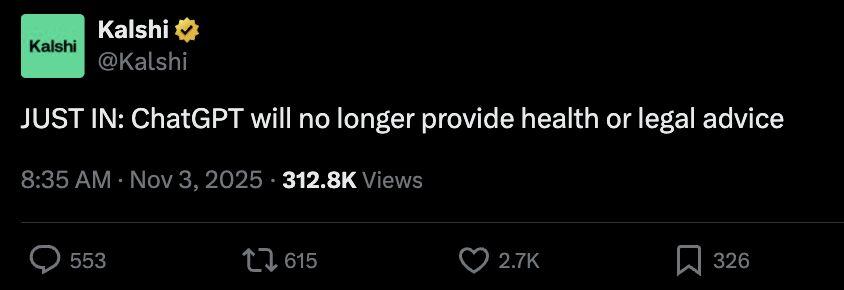

Вскоре после публикации обновления информация о нём начала стремительно разлетаться по социальной сети X. В вольных пересказах пользователей ситуация преподносилась именно как введение полного запрета на оказание сервисом медицинских и юридических консультаций.

Авторство такой интерпретации приписывается аккаунту платформы Kalshi, из которого оно вскоре было удалено. Тем не менее, похожие по смыслу сообщения примерно в то же время одновременно публиковали и другие аккаунты.

Резонанс, который возник вокруг этой темы среди пользователей «X», быстро привлёк внимание журналистов. И уже скоро заголовки про «запрет» появились в СМИ. Материалы с такими формулировками выпустили TechTimes, Financial Express, IBTimes и ряд других изданий. В результате тема стремительно вышла за пределы соцсетей и закрепилась в информационной повестке.

Искусственный интеллект — перспективы и риски

Был ли запрет давать подобные советы в действительности?

Примечательно, что всё это время ChatGPT спокойно отвечал на медицинские и юридические вопросы. Любой пользователь мог убедиться в этом самостоятельно. Более того, вскоре после появления первых сообщений о «запрете» представители OpenAI открыто их опровергли.

Глава направления Health AI в OpenAI Каран Сингхал написал в своём аккаунте в «Х», что сообщения о «запретах» обманывают читателей. А компания не вводила никаких новых ограничений на работу ChatGPT.

Позже об этом написали и СМИ. Verge, MoneyControl, Tom’s Guide и другие медиа, ссылаясь на представителей OpenAI, уточнили: фактически никаких жёстких ограничений, о которых говорили пользователи, компания не вводила. Но почему же тогда вообще возникла история про запрет, которого не было?

Как пользователи воспринимают новости, сгенерированные искусственным интеллектом?

Что на самом деле написано в новом пользовательском соглашении OpenAI?

Как это часто бывает, природа фейка лежит в неверной интерпретации базового документа, обновлённого пользовательского соглашения OpenAI. Дословная формулировка, содержащаяся в обновленной версии, выглядит так:

«Вы не можете использовать наши сервисы для следующего:… предоставление специализированных консультаций, требующих лицензии, таких как юридические или медицинские консультации, без соответствующего привлечения лицензированного специалиста…».

При поверхностном прочтении эти слова действительно могут показаться запретом. Но речь идёт отнюдь не о блокировке функций, а о напоминании пользователям: ChatGPT не должен заменять врача или адвоката и не может использоваться как источник профессионального диагноза или юридического заключения. Причём такие правила не являются новыми. Они присутствовали и в прежних версиях документа.

Почему новость о запрете нейросети давать юридические и медицинские консультации так быстро разошлась?

История оказалась настолько живучей не случайно. Её распространению способствовали сразу несколько факторов.

Первый фактор — технофобия. К 2025 году страхи вокруг генеративного ИИ достигли рекордных значений. Опросы показывают, что более половины жителей развитых стран не доверяют искусственному интеллекту. А в США и вовсе фиксируется массовое отношение к ИИ как к одной из потенциальных угроз существованию человечества. На этом фоне ChatGPT, который остаётся крупнейшим сервисом на рынке и занимает, по разным оценкам, от 60 % до 82 % всего его объёма, невольно становится главным объектом общественной тревоги.

Chaos GPT – искусственный интеллект, имеющий цель уничтожить человечество?

Второй фактор — реальные проблемы. В 2024-2025 годах СМИ сообщили сразу о нескольких резонансных случаях, когда пользователи злоупотребляли советами ChatGPT и сталкивались с серьёзными последствиями. Пресса писала о людях, которые на основе советов сервиса пытались составлять судебные документы, ссылаясь на выдуманные прецеденты, принимали неверные решения о своём здоровье или даже получали информацию о способах самоубийства. На фоне таких историй новость о введении Open AI жёстких ограничений выглядит довольно правдоподобной.

Третий фактор — чувствительность темы. Исследования показывают, что медицинские и юридические вопросы входят в число самых популярных запросов к ChatGPT. Примерно каждый шестой пользователь интересуется медициной, а каждый пятый — правовыми темами. При общей аудитории сервиса в 800 миллионов человек — это огромные масштабы. Поэтому даже намёк на возможный запрет консультации по данным темам вызовет живой интерес. А у части аудитории ещё и тревогу.

Краткий вывод о правдивости

Новость о том, что OpenAI запретила ChatGPT давать медицинские и юридические советы — фейк. Правила использования сервиса действительно были обновлены. Однако введённые изменения были нацелены лишь на оптимизацию действующих принципов и обеспечение более строгого их соблюдения. Никаких новых запретов не вводилось. ChatGPT по-прежнему может отвечать на медицинские и юридические вопросы, хотя и не заменяет собой врача, юриста или другого лицензированного специалиста.

Понравилась статья? Прочитай другие новости проверенные на фейк или обучись медиаграмотности сам_а!

Ищешь, где смотреть проверенные новости? Подпишись!